La course aux supercalculateurs à intelligence artificielle n’est plus seulement l’affaire des États-Unis, de l’Europe ou de la Chine. Taïwan vient de franchir un pas avec une installation très sérieuse : un nouveau supercalculateur IA de collaboration entre ASUS et le National Center for High Performance Computing (NCHC). Le système est déjà opérationnel et est né avec une mission claire : fournir de la puissance informatique à l’écosystème de l’IA du pays, tant au niveau académique qu’industriel.

Le cœur de ce projet est Nano4un système qui combine une double architecture informatique avec du matériel de nouvelle génération de NVIDIA et une conception de refroidissement liquide intégrée rarement vue en dehors des grands centres de données. Le résultat est Performance 81,55 PFLOPS sur la liste TOP500 et classée numéro 29 mondialeune carte de visite non négligeable pour une installation qui débute axée sur l’IA générative, le big data et le HPC.

Double architecture avec les dernières nouveautés de NVIDIA

L’un des points différenciants de ce supercalculateur est qu’il ne se limite pas à un seul type de nœud. NCHC et ASUS ont opté pour une double architecture informatique pour pouvoir attaquer différents types de charges de travail avec la même plateforme.

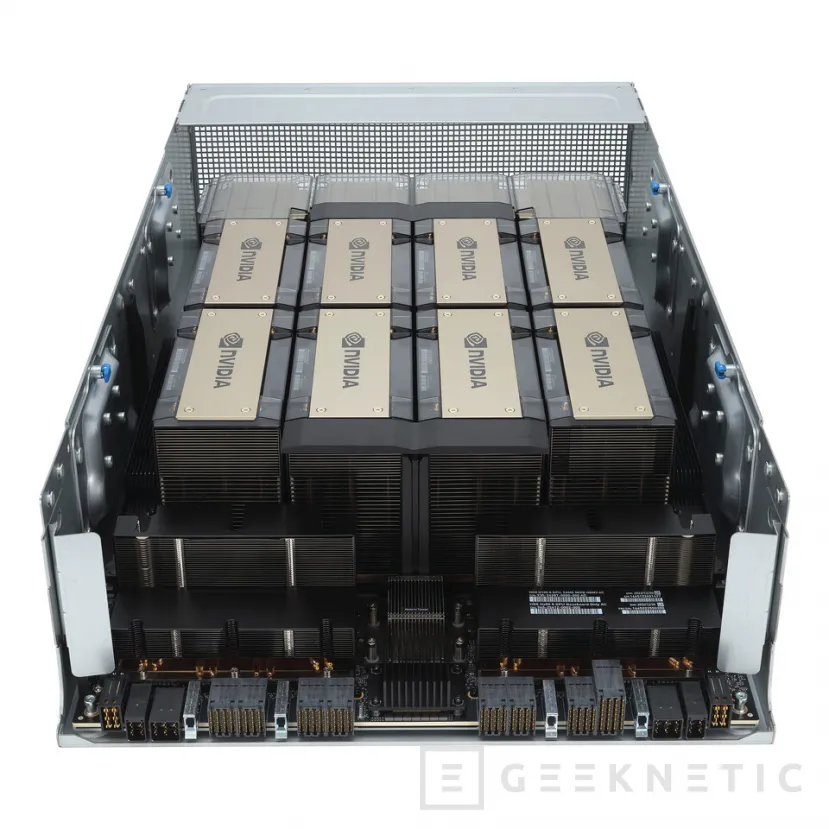

D’une part il y a le cluster basé sur Système ESC NM2N721-E1 conçu par ASUS autour de l’architecture NVIDIA GB200 NVL72. Chaque rack intègre 36 processeurs NVIDIA Grace et 72 GPU NVIDIA Blackwell reliés à haute vitesse, une conception conçue pour former et régler de grands modèles d’IA où la puissance brute et la bande passante inter-puces sont importantes.

En parallèle, le centre dispose de serveurs ASUS hautes performances qui offrent une flexibilité et une évolutivité supplémentaires. C’est là que les systèmes entrent en jeu. NVIDIA HGX H200, refroidissement liquide direct sur puce et serveurs ESC8000-E12 avec accélération basée sur GPU NVIDIA MGX H200 et liaisons NVLink Bridge. Cette gamme de nœuds permet tout, de la formation massive aux tâches d’inférence, en passant par les simulations scientifiques ou l’analyse de gros volumes de données.

Déplacer des dizaines de GPU Blackwell et H200 jusqu’à la limite a un coût thermique énorme. Pour éviter de transformer la pièce en four et, par la même occasion, garder la facture d’électricité sous contrôle, ASUS a conçu le superordinateur de A à Z avec refroidissement direct par liquide (DLC).

Au lieu de compter sur l’air froid circulant entre les serveurs, La chaleur est extraite directement des composants critiques à l’aide de blocs d’eau et de circuits fermés.

Dans le Mesure PUE (Power Usage Effectiveness)le complexe atteint une valeur de 1,18, bien en dessous de ce qui est habituel dans les centres de données conventionnels.

Stockage préparé pour l’avalanche de données

Un supercalculateur IA n’est pas très utile sans un sous-système de stockage correspondant. Les modèles d’IA générative et les projets de science des données fonctionnent avec des pétaoctets de données, et y accéder avec la latence la plus faible possible est tout aussi important que de disposer de nombreux GPU.

Pour couvrir cette partie, ASUS a déployé serveurs de stockage OJ340A-RS60 et RS501A-E12-RS12Upréparé pour les configurations 100 % Flash, les systèmes hiérarchisés et les sauvegardes intégrées. Ils prennent en charge les fichiers, les objets et les blocs, de sorte que le même backend peut alimenter à la fois les applications d’IA et les charges HPC classiques.

De plus, l’entreprise a fait tout son possible pour accélérer le démarrage avec ASUS Infrastructure Deployment Center (AIDC), votre solution d’automatisation pour les clusters hautes performances.

Services professionnels et mise à l’échelle personnalisée

Au-delà du matériel, ASUS profite de ce projet pour renforcer sa position d’intégrateur de référence en matière de supercalcul IA. La société fournit non seulement des serveurs et des racks, mais propose également des services professionnels couvrant la validation de l’infrastructure, l’intégration avec les systèmes de réseau et de stockage existants et l’optimisation du refroidissement liquide..

L’idée est que les organisations publiques et privées peuvent reproduire, adapter ou faire évoluer ces types d’installations sans avoir à créer toutes les connaissances à partir de zéro. Avec des décennies d’expérience dans les serveurs et les centres de données, et un historique de plus de 1 900 enregistrements dans les benchmarks SPEC CPU et de plus de 230 marques dans MLPerf, ASUS cherche à devenir un partenaire stratégique pour ceux qui souhaitent franchir le pas vers l’IA à grande échelle.

Pour Taïwan, le nouveau supercalculateur NCHC va bien au-delà d’une simple liste de spécifications techniques. Il devient un élément clé pour attirer des projets de recherche, des startups en IA et des collaborations internationales.

C’est aussi une manière de démontrer que l’écosystème taïwanais ne fabrique pas seulement des puces et des composants, mais aussi est capable de construire et d’exploiter des infrastructures complètes de nouvelle génération. Dans un contexte où l’IA est devenue un atout stratégique, disposer d’une machine comme Nano4, avec une double architecture, un refroidissement liquide intégré et une conception orientée vers la durabilité, est une déclaration d’intention.

En bref, l’alliance entre ASUS et NCHC place Taiwan sur la carte du supercalculateur IA avec un système moderne, efficace et prêt pour les prochaines vagues de modèles et d’applications. Et, incidemment, cela renforce le rôle d’ASUS comme l’un des grands noms à suivre en matière d’infrastructure pour l’intelligence artificielle à grande échelle.