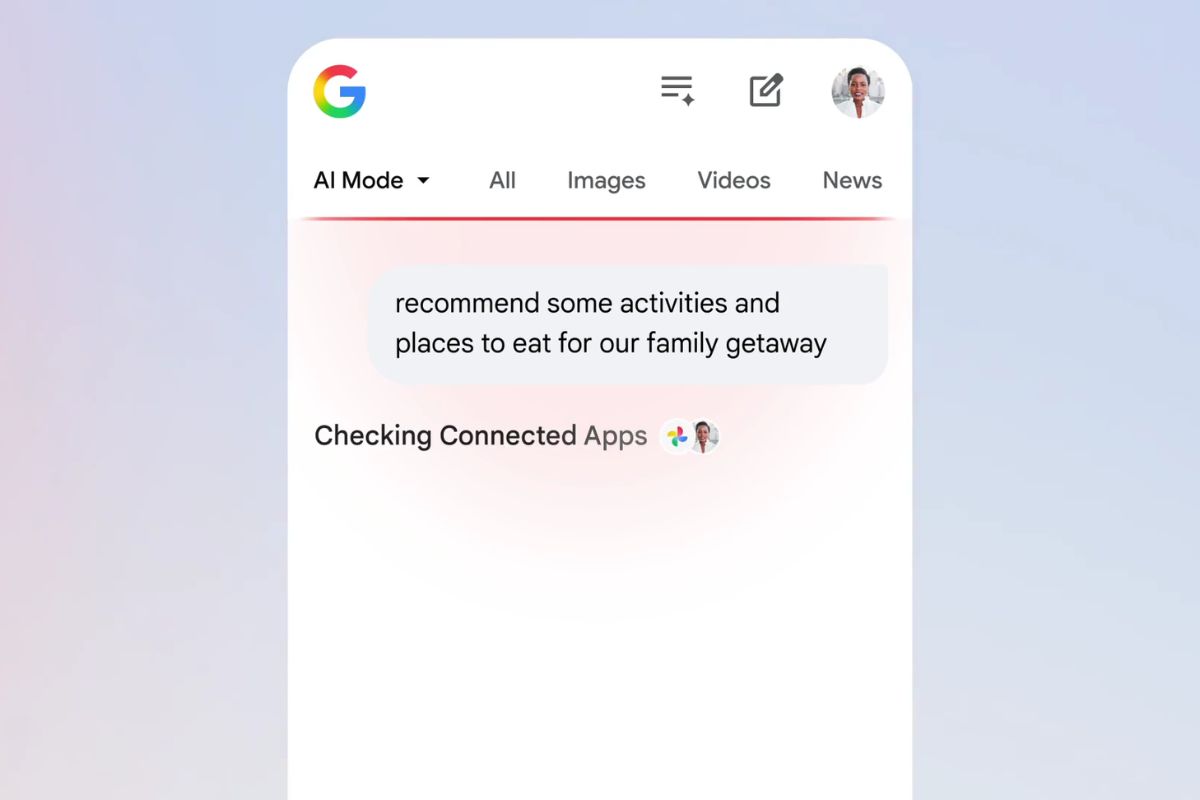

Google a décidé d’abattre la dernière barrière entre son moteur de recherche et la vie privée de ses utilisateurs. Sous le nom de Intelligence personnellela société a annoncé une nouvelle fonctionnalité pour son mode AI qui permet à Gemini d’accéder aux données et de les croiser directement depuis Gmail et Google Photos. Initialement disponible pour les abonnés des forfaits AI Pro et Ultra aux Etats-Unis, cet outil promet des résultats hyper-personnalisés, mais au prix d’un algorithme fouinant dans les fichiers les plus intimes.

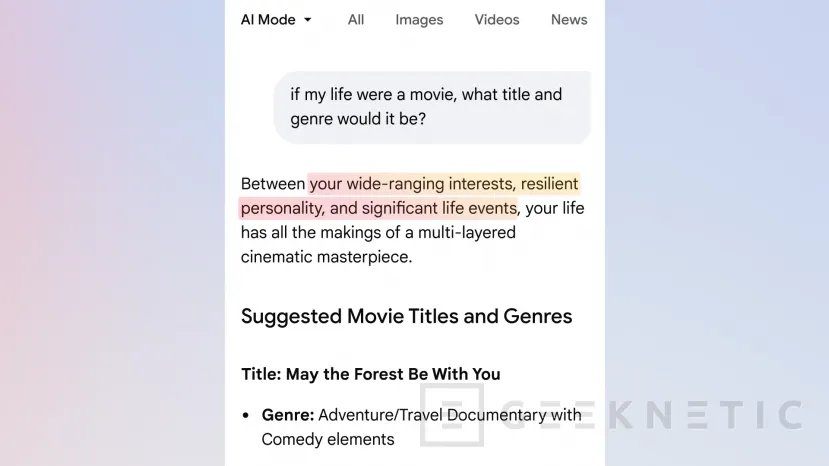

Le principe technique est de relier les points. Si un utilisateur recherche des recommandations de voyage, l’IA ne se limitera plus à proposer des guides touristiques génériques issus du web. Vous pouvez désormais lire la confirmation de vol dans le courrier pour connaître les dates et la destination, et numériser la galerie de photos pour vous rappeler les types de restaurants ou d’activités que la famille a appréciés dans le passé. Le résultat : un itinéraire sur mesure ou des suggestions d’achat de vêtements adaptés au climat de la destination et aux marques que porte habituellement l’utilisateur.

La fin de la recherche neutre et le risque d’hallucinations

Même si Google présente cela comme une évolution naturelle vers l’utilitaire, l’approche éditoriale change drastiquement la nature du moteur de recherche. L’expérience classique, où l’utilisateur comparait différentes sources web de manière plus ou moins neutre, se dilue au profit d’une réponse unique digérée par l’IA. Ce décourage de cliquer vers les sources originales, aggravant ainsi la crise des médias et des créateurs de contenu qui dépendent de ce trafic pour survivre.

En plus, la perception de la vie privée est compromise. Même si l’entreprise assure qu’il s’agit d’une fonction volontaire et que le modèle n’est pas entraîné directement avec ces données, le sentiment qu’une IA analyse chaque email et photo suscite des inquiétudes. À cela s’ajoute le problème non résolu de hallucinations.

Google lui-même admet que « des erreurs peuvent survenir » et que le système pourrait établir des connexions incorrectes. Si une hallucination avec des données publiques est déjà problématique, une hallucination impliquant des données financières, médicales ou personnelles extraites par erreur d’un courrier électronique privé augmente le risque de manière exponentielle, transformant le participant en une source de confusion potentiellement dangereuse. Heureusement, il existe encore des moyens de désactiver l’IA sur Google.